Gerador de texto na rede social afirmou que músicas da banda foram removidas de serviços de streaming por suposta ligação com supremacistas. Plataforma admitiu erro e disse que ele foi corrigido. Inteligência artificial do Instagram associa banda a supremacia branca por engano

Reprodução

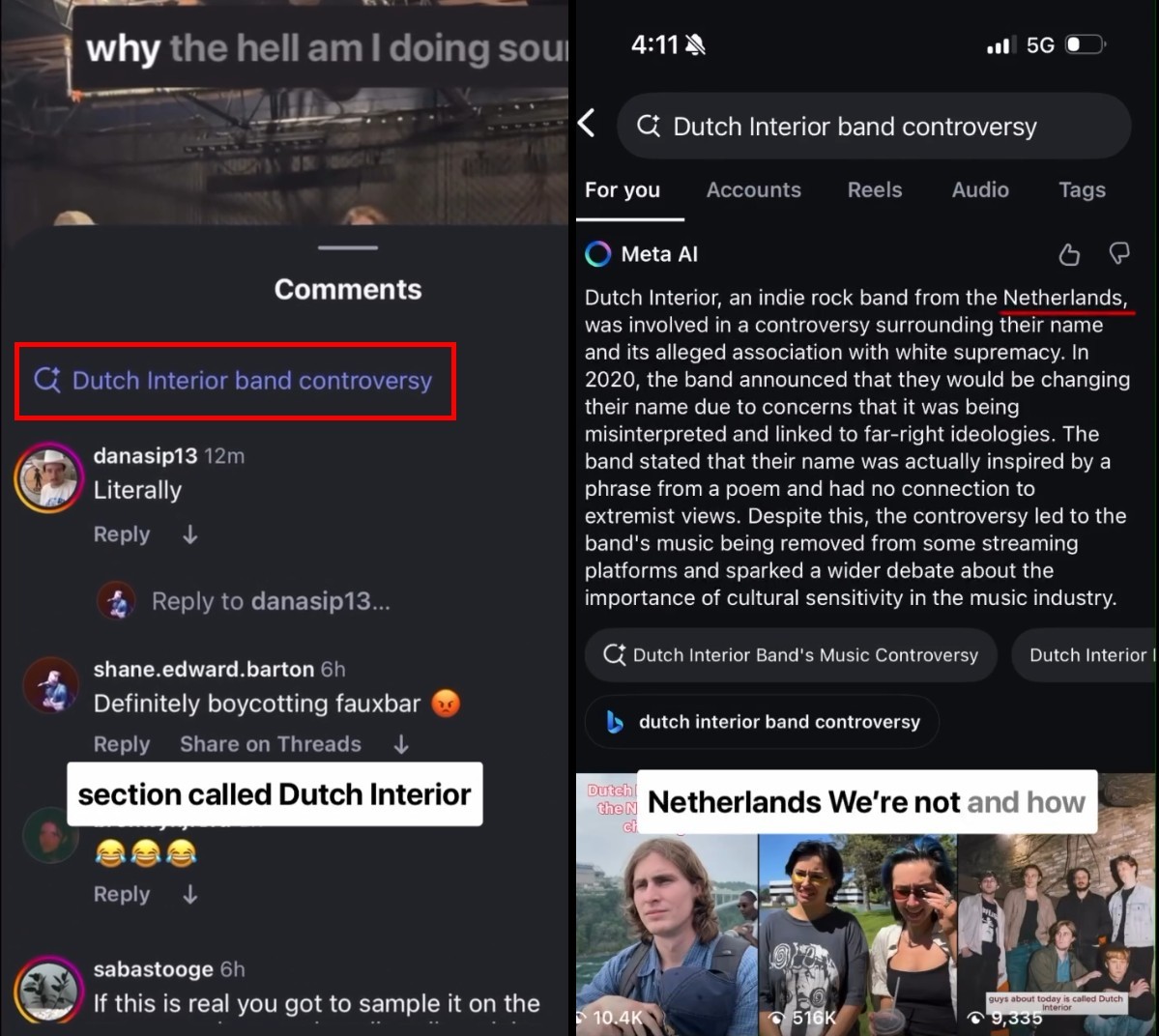

Um recurso do Instagram que usa inteligência artificial para gerar textos associou por engano membros de uma banda a grupos de supremacia branca.

A funcionalidade está dentro do pacote Meta AI, que também deu respostas erradas quando foi lançada no WhatsApp. Ela é parecida com o que já existe no TikTok, que coloca um link em termos que a plataforma considera mais relevante para os usuários.

O erro foi revelado em 3 de julho por um dos integrantes da Dutch Interior, uma banda americana. A Meta, dona do Instagram, admitiu a falha e disse que ela foi corrigida.

Segundo o músico, a acusação falsa apareceu como sugestão de busca na seção de comentários de um vídeo com mais de 90 mil visualizações até quinta-feira (10).

Alguns usuários poderiam ver um atalho para uma página que trataria sobre uma suposta “polêmica do Dutch Interior”. O recurso não está disponível no Brasil.

O Instagram afirmou indevidamente, em um texto gerado por IA, que o nome da banda tinha “suposta associação com a supremacia branca”.

A rede social disse ainda que serviços de streaming removeram músicas da banda por esse motivo e que o grupo mudaria de nome por medo de ser mal interpretado e ligado pelo público a ideologias de extrema direita.

Mas nada disso aconteceu: a banda continua disponível em serviços de streaming, seu nome não foi alterado e não foi possível encontrar nenhuma menção na internet sobre associação com supremacia branca.

O recurso errou até mesmo a nacionalidade da banda, chamando-a de holandesa – o nome do grupo significa “interior holandês”.

“A Meta AI inventou uma polêmica falsa sobre a nossa banda e a promoveu no Instagram para milhares de pessoas”, disse o músico que revelou o caso.

“Só queremos saber como isso pode ser permitido. Nosso vídeo teve dezenas de milhares de visualizações, o que significa que milhares de pessoas que nunca tinham ouvido falar de nós podem ter sido expostas a essa desinformação”.

Procurada pelo g1, a Meta disse que corrigiu o problema assim que o identificou e pediu desculpas pelo erro.

“Como qualquer sistema de IA generativa, pode não retornar as respostas que pretendemos. Estamos constantemente buscando feedback sobre a Meta AI e nossos modelos para aprimorá-los ao longo do tempo”, disse a empresa, em nota.

A Meta não explicou em quais situações ele é exibido e quais as fontes do conteúdo exibido aos usuários.

LEIA TAMBÉM:

Brasileiros ‘invadem’ perfil de Trump e dominam comentários: ‘Deixe o Brasil em paz’

Grok, IA de Musk, exalta Hitler em postagens e apaga conteúdo após denúncias

Cinzas no espaço: como funcionam e quanto custam os voos funerários

DeepSeek, ChatGPT e Gemini: qual é a melhor inteligência artificial?

Meta AI no WhatsApp: o que é a nova ferramenta de inteligência artificial e como utilizar